OpenClaw 在数周内拿下 180,000 个 GitHub Star,这个速度在开源史上不多见。但我更关心的不是数字,而是它真的改变了我的工作方式。用了 3 个多月之后,我有一些实战心得想分享——包括它怎么帮你省时间,以及有哪些坑你可以直接绕过。

OpenClaw 到底是什么?为什么值得用

简单说:OpenClaw 是一个开源 AI 助手框架,你可以把它部署到云端,然后接入 Telegram、Discord、WhatsApp、飞书、钉钉等几乎所有主流 IM 平台。部署完成后,它就是一个 7×24 在线的 AI 同事——有完整的操作权限,有长期记忆,能执行各种自动化任务。

它爆火的原因其实很朴素:以前你要实现类似功能,得自己写 Bot、搭 Pipeline、维护服务器;OpenClaw 把这些全打包好了,门槛直接砍掉一半。

不过,我刚上手的时候踩了一个大坑。

第一个坑:默认配置的代价

很多人装完就直接用,然后月底账单一出来傻眼了。OpenClaw 的默认内存系统会把它知道的所有内容全部注入每次对话的上下文——你问它一个工作问题,它先把你的购物清单、项目备注、聊天记录全塞进 Prompt 里,再开始回答。

据测试,这种情况下每天的 API 费用可以高达 50-100 美元。这个数字不是在吓人——是真实存在的使用场景。

解决方案是什么?主动优化上下文加载策略,而不是什么都往记忆里塞。 具体来说:

– 把不同场景的任务分配给不同的 Agent,每个 Agent 只加载与自己相关的上下文

– 设置记忆分级,常用信息保留,低频信息定期清理

– 对话结束后手动触发压缩,避免无效 token 堆积

记住这条:工具不是目的,效率才是。 如果用 OpenClaw 反而让你花更多钱、管更多事,那就本末倒置了。

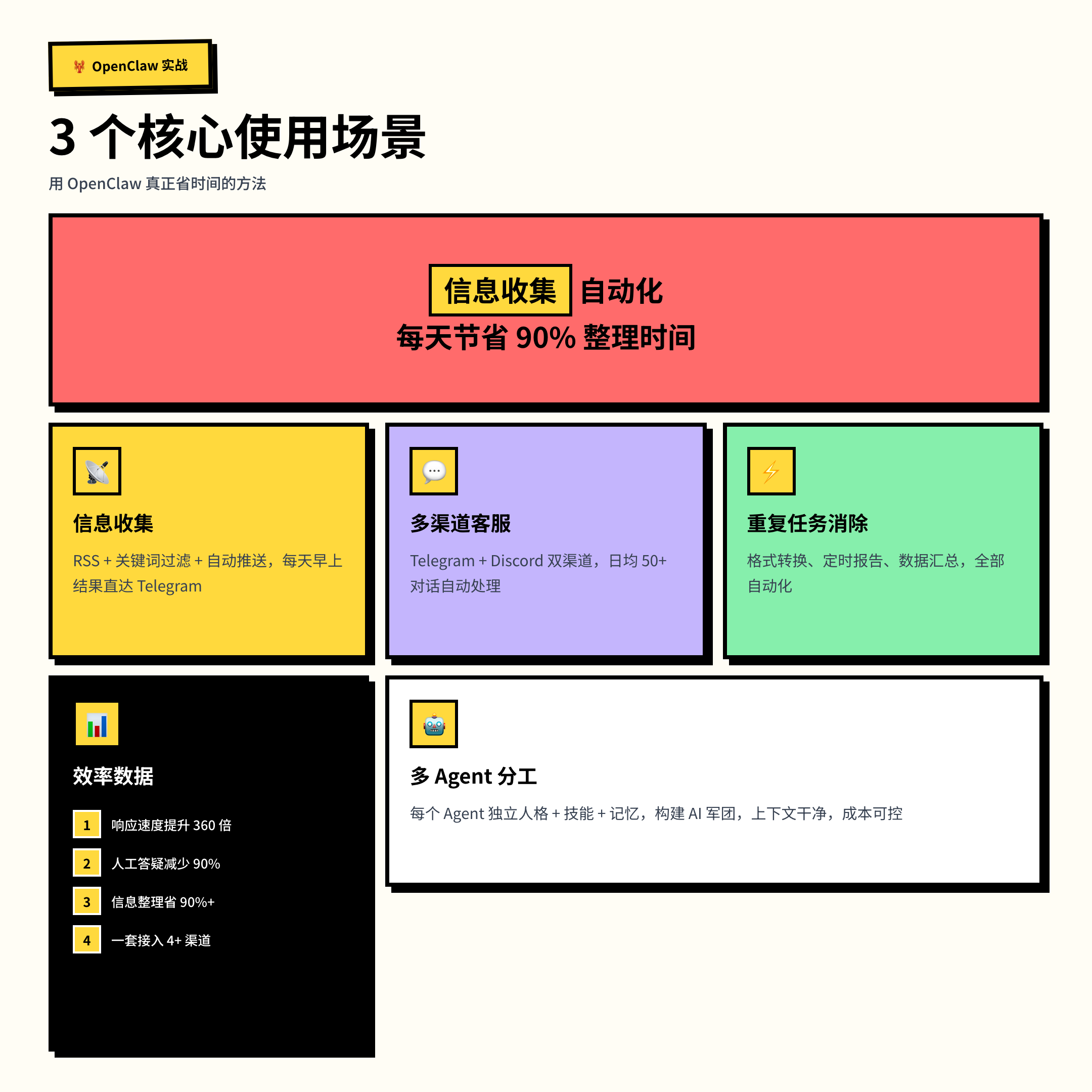

我的 3 个核心使用场景

场景一:信息收集自动化

以前我每天要花 1-2 小时手动搜索、整理信息——看行业资讯、筛选有用内容、归档到笔记。现在这个流程完全交给 OpenClaw,它按我设定的规则自动汇总推送,我只需要看结果就行。

节省的时间保守估计在 90% 以上。这不是夸张,是切实的时间差。

配置思路很简单:给 OpenClaw 设定一组信息源(RSS、特定网站)+ 过滤关键词 + 推送渠道(我用 Telegram),每天早上自动发给我。如果你用过 IFTTT 或 n8n,这个逻辑你一定不陌生,但 OpenClaw 的优势是它能做更复杂的内容理解和筛选,不只是转发。

场景二:多渠道客服/答疑自动化

我帮一个社群部署了一套答疑系统:用腾讯云 Lighthouse 一键部署 OpenClaw,配置 DeepSeek 模型,同时接入 Telegram 和 Discord 两个渠道。

效果很直接:日均自动处理 50+ 条对话,响应时间从平均 30 分钟压缩到秒级,人工答疑工作量减少了约 90%。

划重点:不要只报百分比,要报绝对数字。 “从 30 分钟降到秒级”比”提升 3600%”更有说服力,更让人有概念。同样的效率提升,后者的表达方式反而显得虚。

这套逻辑也适用于其他场景——闲鱼客服、会员群答疑、内部 FAQ 机器人,核心都是一套 OpenClaw 实例接多个渠道,统一管理。

场景三:重复任务消除

有些任务本来就不需要人参与,但因为没有自动化工具,一直在消耗你的注意力。OpenClaw 最适合的就是这类任务:格式转换、定时报告、数据汇总、会议纪要整理……

有意思的是,很多人部署完 OpenClaw 之后发现:它帮你省时间的,往往不是你最初设想的那个场景,而是那些你”以为很小、懒得优化”的任务。

进阶:多 Agent 分工

用一段时间之后,你会遇到一个问题:单个 Agent 处理太多类型的任务,记忆会越来越混乱,Token 消耗也会越来越高。

解决办法是建立多 Agent 体系——每个 Agent 有独立的人格、技能集、工作空间和记忆。你可以把它理解成:不是一个全能员工,而是一个专业团队。

- Agent A:只负责信息收集和整理

- Agent B:只负责客服答疑

- Agent C:只负责内部报告生成

这样每个 Agent 的上下文保持干净,不会互相污染,API 成本也显著下降。

OpenClaw 原生支持多 Agent 配置,你只需要在管理面板里分别创建、配置就行。这是从”能用”到”好用”的关键一步。

速率限制怎么解决?

另一个常见问题是:高频使用时会触及 API 速率限制,导致任务中断。

有一个叫 Channel Models 的方案可以解决这个问题。核心思路是:不同的渠道使用不同的模型配置,分散请求压力,避免单点打满。具体的配置步骤因使用的 API 供应商而异,可以参考 Alessandro Colford 的视频教程(YouTube 搜索”OpenClaw Channel Models”能找到)。

这个方案据称可以实现效率提升 10 倍,我没有精确验证这个数字,但方向是对的:分布式请求比单点请求更稳定,这是基本道理。

部署其实很简单

如果你还没有开始,可以参考这个路径:

- 在腾讯云 Lighthouse 用 OpenClaw 应用模板一键部署(国内访问稳定,成本低,官方活动有折扣)

- 配置模型 API(DeepSeek 是性价比较高的选择,成本控制很重要)

- 接入你最常用的一个 IM 渠道,先验证基础功能

- 跑通之后再考虑多渠道扩展

这个过程本身也是一个完整的技术项目,涉及云服务器管理、API 密钥配置、Webhook 集成、Linux 服务持久化——如果你是技术人,这些细节值得认真做一遍,是真实可量化的工程经验。

复杂的事情简单化,简单的事情标准化。 把部署流程跑通一遍,记录下来,以后迁移或复用就快了。

写在最后

OpenClaw 不是什么魔法,它的本质是:把原本需要你反复手工操作的事情,变成一个持续运行的自动化流程。

用它之前,先想清楚你想解决什么问题。把效率提升量化出来:之前多少时间,之后多少时间,差值是多少。这个思路不只适用于 OpenClaw,适用于所有效率工具。

如果你已经在用 OpenClaw,欢迎在评论区分享你的实战案例——尤其是那些意想不到的使用场景。如果你还没开始,现在入手是个好时机,工具已经成熟了。

如果这篇文章对你有帮助,欢迎留言讨论。