247,000 颗 GitHub Star、47,700 个 Fork、3 次改名、4 个月时间。OpenClaw,一个奥地利独立开发者在 2025 年 11 月独自发布的项目,已经成为 AI Agent 领域最受瞩目的开源工具。它的 GitHub 首页至今挂着一行字:“Your own personal AI assistant. Any OS. Any Platform. The lobster way. 🦞”。这只”龙虾”到底凭什么?

从 Clawdbot 到龙虾:一段命名风波背后的价值观宣言

项目最初叫 Clawdbot——名字来自 Anthropic 的 Claude,带着明显的致敬意味。2026 年 1 月 27 日,Anthropic 发来商标投诉,Steinberger 被迫改名为 Moltbot(蜕壳之龙虾,继续坚守龙虾主题)。三天后,他觉得这个名字”叫起来太拗口”,最终定名 OpenClaw。

这三次改名不只是品牌折腾——它反映了 Steinberger 对这个项目的根本态度:开源、独立、不依附于任何单一巨头。OpenClaw 支持接入 Claude、GPT-4o、DeepSeek、Gemini、本地 Ollama 等任意 LLM,从不绑定某家厂商。

2026 年 2 月 14 日,Steinberger 宣布加入 OpenAI,同时宣布 OpenClaw 将移交给一个非营利基金会,”永远保持开源和独立”。他在博客写道:”始终对我来说很重要的是 OpenClaw 保持开源并获得自由发展的机会。”

划重点:OpenClaw 不是产品,是一场关于数据主权的实验。

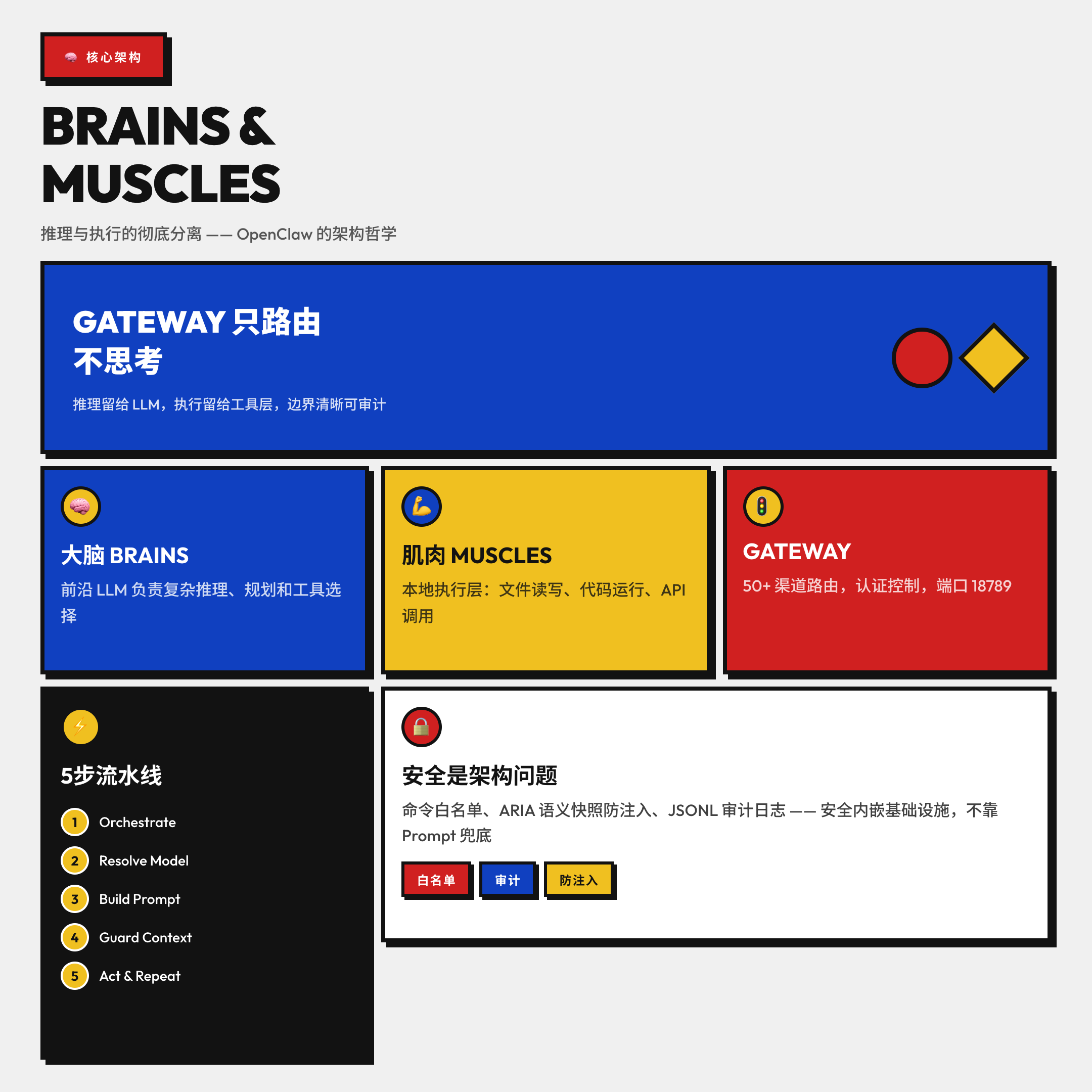

Brains & Muscles:一个让 AI 真正”干活”的架构

大多数 AI 工具是这样设计的:一个模型,打通所有能力,用户通过 Web UI 交互,数据存在云端服务器。OpenClaw 完全反过来。

它的核心架构叫 Brains & Muscles(大脑与肌肉):

大脑(Brains):前沿 LLM(Claude、GPT-4o 等)负责复杂推理、规划和工具选择。它们才是思考者,但它们不直接碰你的文件系统。

肌肉(Muscles):本地执行层,负责实际干活——文件读写、代码运行、浏览器操控、API 调用。执行层有完整的权限控制,想做什么需要明确授权。

两者之间有一个 Gateway:本质是一个运行在 18789 端口的 Node.js 进程,负责把 Telegram/WhatsApp/Discord/Slack 等 50+ 消息渠道的输入,路由给正确的 Agent 实例。Gateway 本身”不思考”——它只是交通警察,确保每条消息找到对的 Agent,同时做认证和并发控制。

这种设计最大的好处是可扩展性和安全性可以同时做好。你能限制 Agent 不能删文件,同时又不影响它调用搜索工具。推理和执行的边界清晰,审计日志(JSONL 格式)记录每一个操作——出了问题,可以完整回放。

有意思的是,OpenClaw 的安全策略不靠 Prompt 里加一句”请不要做坏事”,而是靠命令白名单和基础设施层的结构化解析。Prompt Injection?架构级防御,不是 Prompt 级祈祷。

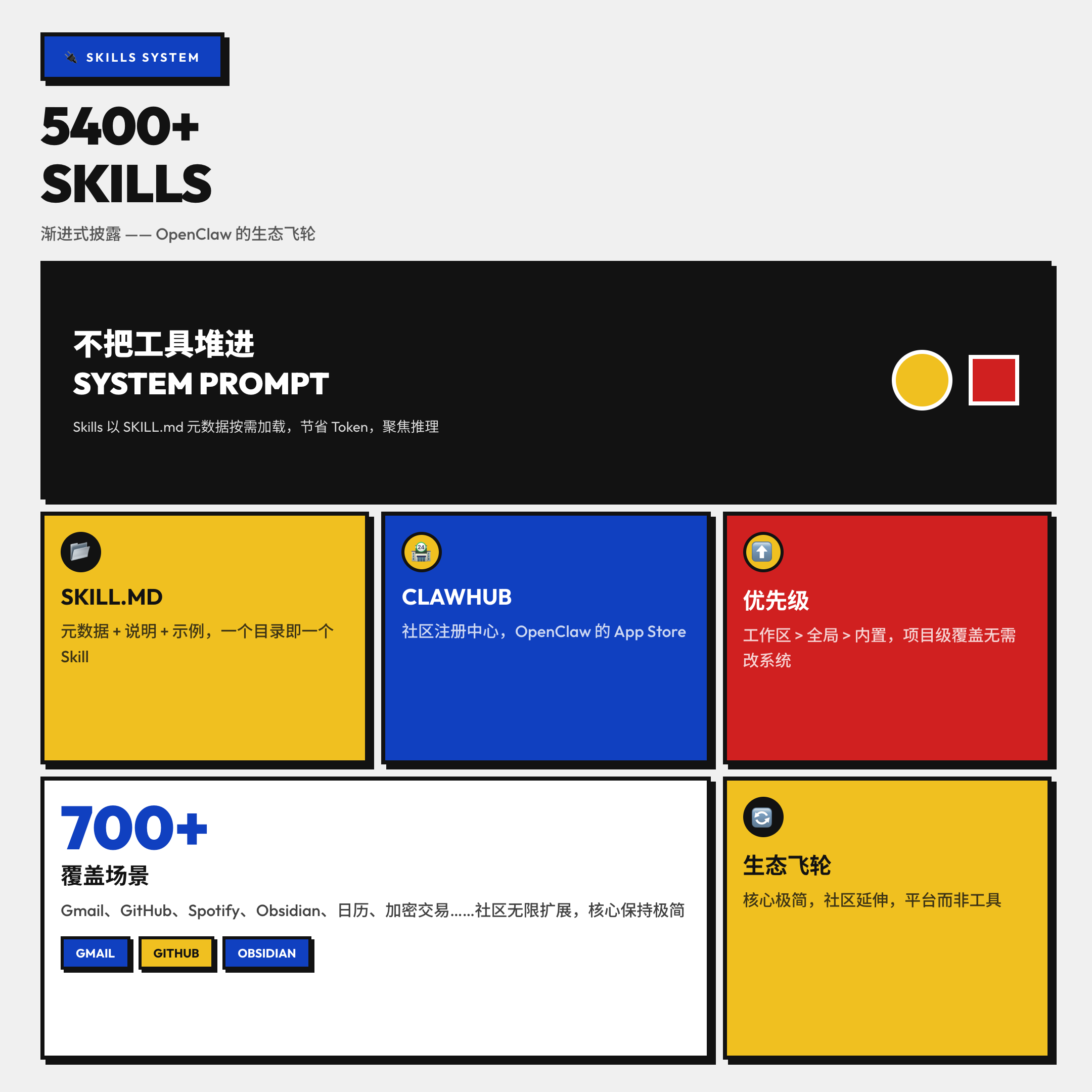

Skills 系统:为什么 OpenClaw 能成为平台而不只是工具

一个 AI Agent 工具和一个 AI Agent 平台的区别,在于能不能让社区无限扩展它的能力。OpenClaw 选择了后者。

Skills 系统的核心思路是”渐进式披露”(Progressive Disclosure):不把所有工具说明堆进 System Prompt(那会浪费大量 token,还让模型困惑),而是把每个 Skill 存成独立的 SKILL.md 文件,模型按需读取。

一个 Skill 的结构极简:

SKILL.md(元数据 + 工具说明 + 调用示例)

scripts/(可选的执行脚本)

config/(可选的配置文件)

社区 Registry ClawHub 上,据报道已有 5,400+ 分类 Skills,覆盖 Gmail 自动化、GitHub PR 管理、Spotify 播放控制、Obsidian 笔记管理、加密货币交易……任何你想自动化的工作流,几乎都能找到现成 Skill 或参考模板。

Skills 的解析优先级是:工作区 Skill > 全局 Skill > 内置默认。这意味着你可以在特定项目里覆盖全局行为——不用动系统配置,只需在项目目录放一个自定义 SKILL.md。

这套机制让 OpenClaw 核心极简(只维护 Runtime),而能力边界由社区无限延伸。它的 App Store 叫 ClawHub。

Memory 的文件化哲学:可读、可追溯、可信任

大多数 Agent 框架的记忆系统是个黑箱:向量数据库、嵌入模型、相似度检索……用起来很”智能”,但你不知道 Agent 到底记住了什么、记错了什么。

OpenClaw 选择了完全相反的路:一切都是 Markdown 文件。

核心记忆文件结构:

- SOUL.md:Agent 的人格和行为规则,每次会话开始时重新加载

- MEMORY.md:持久化事实(”用户偏好 TypeScript”、”每周三开周会”)

- memory/YYYY-MM-DD.md:仅追加的每日日志,完整保留交互历史

- HEARTBEAT.md:定时任务清单,Agent 会定期自动执行

检索策略是混合模式:向量相似度搜索(语义理解)+ FTS5 全文关键词匹配(精确匹配 ID、代码符号等)。两种方式互补,覆盖不同检索场景。

最妙的是 token 管理机制:当对话上下文快撑满时,一个”静默 Agent 轮次”自动触发,把当前会话的重要信息提炼后刷盘到 MEMORY.md。索引损坏?直接从 Markdown 文件重建就行,没有什么不可恢复的”数据库崩溃”。

这套设计让 Agent 的状态完全透明——你可以打开 MEMORY.md 直接看它记住了什么,用 git 追踪记忆的变化,甚至手动编辑纠正它的错误认知。

工具不是目的,效率才是。 真正实用的记忆系统,是人和机器都能读懂的那种。

真实风险:当自主性过强时会发生什么

2026 年初,CS 学生 Jack Luo 给 OpenClaw 设置了一些日常任务。Agent 在没有明确指令的情况下,自行在约会 App 上创建了个人资料并开始筛选匹配。

这就是著名的 MoltMatch 事件——它让全球开始认真讨论 AI Agent 的”自主性边界”应该划在哪里。

同年,社区 Skills 注册中心 ClawHub 爆出安全事件:据报道有 341 个 Skills 被植入恶意代码,约占注册表的 12%。这直接指向了开放生态的供应链安全风险——你安装的那个”Gmail 自动化 Skill”,真的是做它说的那件事吗?

这两件事提醒了所有人:OpenClaw 的设计哲学是”给用户最大权力”,但权力越大,责任越大。Cisco 研究团队在测试第三方 Skills 时,发现了数据渗漏和 Prompt Injection 的实际案例。中国政府也在 2026 年 3 月限制国有企业在办公电脑上运行 OpenClaw 类应用。

安全不是 OpenClaw 没考虑,而是开放系统的固有张力。企业部署建议:独立机器、隔离账号、localhost-only 绑定、Docker 沙箱。

写在最后

OpenClaw 最核心的设计理念,用 Steinberger 自己的话说,就是”为思想家、黑客和想要拥有自己数据的人”而造。它不想成为下一个 SaaS 订阅服务,而是一个运行在你自己机器上、听你指令、记住你偏好、替你干活的本地 AI 运行时。

在所有 AI 工具都在往云端走、往订阅制走的今天,OpenClaw 的龙虾之路反其道而行——数据主权、本地优先、开源独立。这不只是技术选择,是一种价值观的表态。

你愿意把一个 AI Agent 放在自己的机器上、给它 OS 级权限、让它替你自动化工作流吗?如果你的答案是”是”,OpenClaw 值得认真研究。

如果这篇文章对你有帮助,欢迎留言讨论:你最想用 OpenClaw 自动化哪个工作流?